【2023】ChatGPTには機密情報漏洩リスクがある?企業が取るべき対策を弁護士が解説

ChatGPTが、非常に話題となっています。業務に活用したいと考えている方や、すでに業務に取り入れたという方も少なくないのではないでしょうか?

では、ChatGPTに機密情報を入力した場合、漏洩するリスクはないのでしょうか?今回は、ChatGPTに機密情報を入力するリスクや企業が講じるべき対策などについて詳しく解説します。

目次

ChatGPTとは

ChatGPTとは、OpenAI社が開発したAIチャットツールです。はじめに、ChatGPTの概要について解説しましょう。

ChatGPTの概要

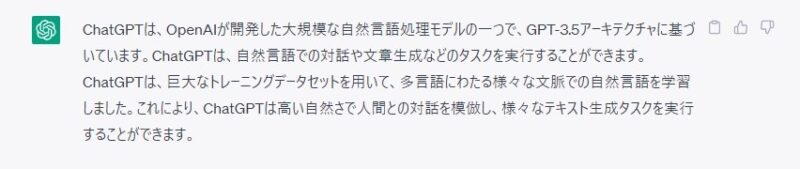

ChatGPTに質問を投げかけると、ものの数秒で自然な回答が返ってきます。たとえば、ChatGPTに「ChatGPTとは」と入力すると、次の返答が返ってきます。

ChatGPTは、OpenAIが開発した大規模な自然言語処理モデルの一つで、GPT-3.5アーキテクチャに基づいています。ChatGPTは、自然言語での対話や文章生成などのタスクを実行することができます。ChatGPTは、巨大なトレーニングデータセットを用いて、多言語にわたる様々な文脈での自然言語を学習しました。これにより、ChatGPTは高い自然さで人間との対話を模倣し、様々なテキスト生成タスクを実行することができます。

このように、ChatGPTはまるで人間のように自然な対話を行います。他にも、ユーザーのインプットに応じたメール文章や小説を生成したり、プログラミングコードを書いたり、ブログ記事や構成をアウトプットしたりするなど、多様な活用が可能です。

ChatGPTの使い方

ChatGPTは、ユーザー登録をするのみで使うことができます。

まず、パソコンなどで「ChatGPT」と入力すると「Introducing ChatGPT」が表示されるので、ここから「Try ChatGPT」をクリックすると、ログイン画面に移行します。

そこにメールアドレスを入力してアカウントを作成するか、Googleなどのアカウントを使ってログインをすることで、すぐにChatGPTの利用が可能です。「Send a message」欄に入力すると、ChatGPTとの対話が始まります。

ChatGPTには有料プランもありますが、Free planであれば利用料もかかりません。なお、このようなAIツールは英語のみに対応している場合が多いものの、ChatGPTは日本語にも対応しています。

ChatGPTは商用利用できる?

アプリケーションやITツールの中には、商用利用が禁じられているものや、商用利用専用のプランを別途設けているものも多数存在します。

では、ChatGPTを商用利用することは、問題ないのでしょうか?順を追って解説していきましょう。

商用利用は禁止されていない

執筆している2023年(令和5年)5月現在、ChatGPTを商用利用することは禁止されていません。また、ユーザーの入力によるChatGPTでのアウトプットは、ユーザーに帰属するとされています。

ただし、コンテンツ ポリシーと利用規約に従うことが必要です。これについてはChatGPTの公式サイトに掲載されている「ChatGPTに関するよくある質問」で、次のQ&Aが公表されています。

14.ChatGPT の出力を商用利用できますか?

コンテンツ ポリシーと利用規約に従い、ChatGPT で作成したアウトプットは、転載、販売、商品化する権利を含め、無料または有料のプランで作成されたかどうかにかかわらず、所有します。

商用利用は慎重にすべき

ChatGPTの商用利用が禁止されていないとはいえ、ChatGPTの商用利用は慎重とすべきでしょう。なぜなら、ChatGPTには機密情報の漏洩など、さまざまな留意事項があるためです。

ChatGPTを業務で利用する際には、注意点やリスクをしっかりと理解しておくことが必要です。

ChatGPTには機密情報漏洩のリスクがある?

ChatGPTを使うことで、機密情報が漏洩する可能性があるのでしょうか?この疑問に対する回答は次のとおりです。

ChatGPTに入力した機密情報は漏洩のリスクがある

ChatGPTに入力した機密情報は、ChatGPTの学習用データに取り込まれたり、OpenAI社のスタッフが目にしたりする可能性があります。これは単なる推測ではなく、ChatGPTの公式サイトに掲載されている「ChatGPTに関するよくある質問」に、次のQ&Aが公表されています。

5.誰が私の会話を表示できますか?

安全で責任ある AI へのコミットメントの一環として、会話を見直してシステムを改善し、コンテンツがポリシーと安全要件に準拠していることを確認します。

6.私の会話をトレーニングに使用しますか?

はい。あなたの会話は、システムを改善するために AI トレーナーによって確認される場合があります。

つまり、社内の機密情報をChatGPTに入力した場合には、その内容がOpenAI社の従業員の目に触れる可能性があるほか、他のユーザーがChatGPTに質問を投げかけた際のアウトプットの参考とされる可能性があるということです。

実際に、ChatGPTがAmazonの社外秘であるはずのデータに酷似したレスポンスを出した(おそらく、Amazonの関係者がChatGPTにその社外秘のデータを入力してしまい、これが学習用データとされた)との情報もあり、注意喚起がなされています。

参照元:Amazonが社員に注意喚起した「ChatGPTに共有してはいけないモノ」(GIZMODO)

ChatGPTへの機密情報の入力を禁じている企業も存在する

ChatGPTによる機密情報の取り扱いを受け、ChatGPTに機密情報を入力することを禁じる企業も増えてきました。

ブルームバーグと フィナンシャルニュースの報道によれば、CitiGroupやBank of Americaなど多くの金融機関が、従業員へのChatGPT使用を制限したようです(※1)。

また、Samsung(サムスン)では従業員がバグのある半導体データベースのソースコードをChatGPTにコピーして修正を依頼したり、会議音声をチャットボットに投げて議事録の作成を試みたりしたことで、機密情報をChatGPTに流出させたとして問題になっています(※2)。

これを受けSamsungは従業員のChatGPTへのプロンプトを制限する措置を講じました。

※1:ゴールドマンら多くの銀行で従業員のChatGPT使用に制限(Forbes JAPAN)

※2:サムスン、機密情報をChatGPTにリークして大問題に(GIZMODO)

企業がChatGPTの情報漏洩で講じるべき対策

ChatGPTの使い方を誤ると、機密情報が漏洩してしまうかもしれません。そのため、企業はChatGPTについて対策を講じることが急務となるでしょう。企業が講じるべき主な対策は次のとおりです。

ChatGPTについてのスタンスを定める

まず企業が行うべきことは、自社におけるChatGPT利用に関するスタンスを定めることです。

金融機関など機密情報を多く取り扱う企業では、ChatGPTの業務利用を全面的に禁止することも一つでしょう。しかし、ChatGPTは使い方を誤らなければ非常に便利なものであり、業務効率化に大きく寄与することも期待できます。

そのため、基本的には自由に活用できるとしたうえで、開発担当者などに限ってChatGPTの職務利用を禁止したり所定の機密情報のみの入力を禁止したりするなども検討の余地があります。

いずれにせよ、もっとも避けるべきなのは、企業が何らChatGPTとの付き合い方を定めないことです。企業が何らスタンスを定めていなければ、Samsungの例のように、従業員が知らぬ間にChatGPTを活用しているかもしれません。

社内規程にChatGPTの利用に関する事項を盛り込む

ChatGPTの普及を受け、社内規程にChatGPTの存在を踏まえた事項を織り込む必要があります。

たとえば、機密情報取扱規程にChatGPTへの入力を禁じる事項を織り込むことなどが挙げられます。また、仮にChatGPTに機密情報を入力した従業員に対して減給などの制裁を加えたいのであれば、その旨を就業規則などに記載する必要があるでしょう。

なお、社内規程を修正する際には、他の規程との整合性を確認しなければなりません。自社での改訂が難しい場合には弁護士へ相談したり、弁護士に確認してもらったりすることをおすすめします。

ChatGPTや機密情報漏洩に関する研修を実施する

思わぬ機密情報の漏洩を防ぐため、社内研修を実施すると良いでしょう。ChatGPTに関する研修を独立して行うほか、機密情報の取り扱いなどに関する研修内容にChatGPTなど生成AIに関する事項を盛り込むことも一つの手です。

研修の講師は社内の詳しいスタッフを起用するほか、弁護士など社外の専門家へ依頼することも検討できます。ChatGPTや機密情報の漏洩事件に詳しい弁護士を講師として起用することで、最新事例や仮に機密情報が漏洩した際の法的なリスクなどについても話してもらえることでしょう。

社外との契約書にChatGPTの利用に関する事項を盛り込む

必要に応じて、社外の委託先との契約書にもChatGPTの活用に関する事項を盛り込むと良いでしょう。

たとえば、IT企業が開発業務などの一部を社外に委託している場合、委託先が業務効率化を図るため、ChatGPTに自社の開発に関するソースコードを入力してしまうかもしれません。これを未然に防ぐためには、自社に関する事項をChatGPTに入力しないよう、契約書に明記する必要があるでしょう。

また、たとえばブログ記事の執筆などを外部ライターへ依頼した場合、ChatGPTを使って記事が書かれる可能性があります。これについては企業ごとに考え方が異なっており、たとえば絶対にChatGPTを使って欲しくないと考える場合もあれば、ChatGPTが返した内容をしっかりと検証したり違和感のないように校正したりするのであればChatGPTを使っても問題ないと考える場合もあるでしょう。

そのため、委託するにあたっては自社のスタンスを定め、仮にChatGPTの使用を禁止するのであればその旨を契約書に明記することが必要です。

弁護士に相談できる体制を整える

ChatGPTは普及してまだ間もないものの、今後ますます活用が広がっていくことでしょう。しかし、ChatGPTに関する判例は出そろっておらず、今後活用していく中で新たな法務リスクが生じる可能性があります。

そのため、ChatGPTを業務で積極的に活用する際には、インターネット法務などに詳しい弁護士へ相談できる体制を整えておくことをおすすめします。

ChatGPTに関するその他のリスク・注意点

機密情報の漏洩以外の、ChatGPTに関するリスクと注意点は次のとおりです。ChatGPTを業務で活用する際には、これらのリスクを十分に理解しておく必要があるでしょう。

ChatGPTの返答が必ずしも正確であるとは限らない

ChatGPTは、さまざまな投げかけへ即座に回答してくれます。しかし、その回答が必ずしも正確であるとは限りません。

中には、事実とは異なる情報を非常にもっともらしく返す場合もあります。特に、医療に関する情報は人命に関わることも多く、ChatGPTの返答をそのまま信じることは非常に高リスクでしょう。

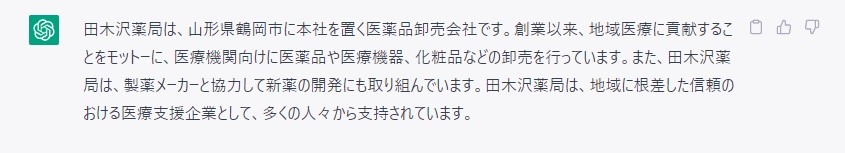

ためしに、「たきざわ薬」という架空の薬について、ChatGPTに「たきざわ薬とは」と投げかけてみました。その回答は、次のとおりです。

田木沢薬局は、山形県鶴岡市に本社を置く医薬品卸売会社です。創業以来、地域医療に貢献することをモットーに、医療機関向けに医薬品や医療機器、化粧品などの卸売を行っています。また、田木沢薬局は、製薬メーカーと協力して新薬の開発にも取り組んでいます。田木沢薬局は、地域に根差した信頼のおける医療支援企業として、多くの人々から支持されています。

まず、「たきざわ薬」と入力したにもかかわらず、いつの間にか「田木沢薬局」という薬局の説明となっています。また、念のため東北厚生局のホームページで確認したところ、「田木沢薬局」なる薬局は存在しませんでした。つまり、この返答はまったくの虚偽(ChatGPTの「妄想」?)ということになります。

このように、ChatGPTの返答が必ずしも正しいとは限りません。ChatGPTが返した内容を業務に活用する際には、その内容について別途確認する必要があるでしょう。

著作権にまつわるトラブルの原因となる可能性がある

ChatGPTなどの生成AIについては、著作権の問題が指摘されています。

たとえば、ユーザーがブログ記事を生成しようとChatGPTに指示を出したところ、インターネット上に存在する他のブログ記事と酷似した内容のアウトプットがなされるかもしれません。ユーザー自身が他者のブログ記事を模倣したわけではないとはいえ、これをそのまま自社のサイトにアップすれば、著作権侵害を疑われてトラブルに発展する可能性があります。

そのため、ChatGPTを使って生成した文章をアップロードする際にはあらかじめコピペチェックツールを活用するなど、対策を検討する必要があるでしょう。

また、自社がインターネット上に公開をした記事が、ChatGPTの学習用データとして使われる可能性も否定できません。これについては自社が独自に対策できる性質のものではないものの、今後活発な議論されていくこととなるでしょう。

なお、ChatGPTの著作権に関しては、こちらの記事で詳しく解説しています。

まとめ

ChatGPTへ入力した情報はOpenAI社のスタッフの目に触れる可能性があるほか、ChatGPTの学習用データとして取り込まれる可能性があります。ChatGPTに自社の機密情報を入力した場合、その後他者が行ったインプットによっては、自社の機密情報と酷似した内容がアウトプットされて情報が漏洩するリスクがあるでしょう。

そのため、ChatGPTには、機密情報を入力すべきではありません。従業員がChatGPTに機密情報を入力することのないよう、社内規程を整備したり研修を実施したりして、対策を講じることをおすすめします。

たきざわ法律事務所では、ChatGPTの活用にまつわる法的支援に力を入れています。ChatGPTの活用に関する社内規程や契約書を整備したい場合のほか、ChatGPTの活用に関してトラブルとなっている場合などには、たきざわ法律事務所までお気軽にお問い合わせください。