弁護士がChatGPTで作った書類に架空の判例が?利用時の注意点と併せて弁護士が解説

ChatGPTとは、イーロン・マスク氏らによって設立されたOpenAI社が開発した、AIチャットツールです。あたかも人間が返答しているかのように、チャット形式で指示に応えたり会話をしたりすることができます。

このChatGPTが大きな話題となっており、さらなる活用方法やより効果的な利用方法が世界中で日々模索されています。そのような中、アメリカ・ニューヨーク州で弁護士が裁判の準備書面の作成にChatGPTを活用したところ、架空の判例が掲載されるという前代未聞の事件が発生しました。

そこで今回は、この事件を紹介しつつ、ChatGPTを業務で利用する際の注意点について解説します。

目次

ChatGPTで弁護士が作成した裁判準備書面に架空の判例が掲載され謝罪する事件が発生

2023年5月下旬、ニューヨーク・タイムズ紙(The New York Times)がChatGPTの利用に関する「悪い見本」ともいうべき事件を報道しました。

参照元:チャットGPTで架空の判例 NY州、弁護士が裁判所に謝罪

報道によると、ニューヨーク州の民事訴訟において弁護士が作成し裁判所へ提出した準備書面の中に、架空の判例が含まれていたようです。なお、裁判の準備書面とは「準備のために作成する手控えの書類」などではなく、訴訟当事者が自身の言い分を記した書類であり、裁判所に提出する書類を指します。

この弁護士は、ChatGPTを使って問題となっている準備書面を作成していました。弁護士は裁判所に謝罪しており、懲戒の是非については今後検討される見込みです。なお、この弁護士は、ChatGPTを初めて利用したと語っているようです。

ChatGPTとは

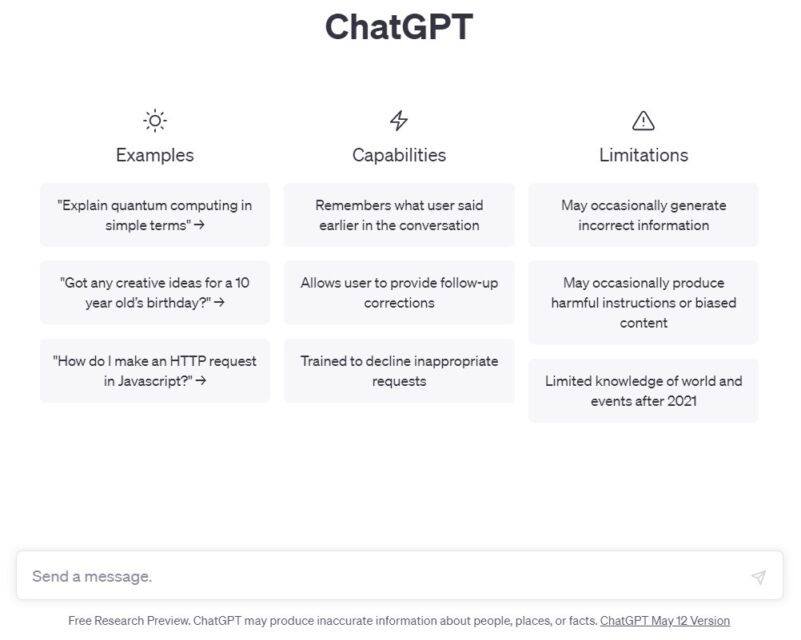

ChatGPTとは、アメリカのOpenAI社が開発した、AIチャットツールです。メールアドレスでアカウントを作成するかGoogleやMicrosoft、Appleなど既存のアカウントからChatGPTへログインすることで、誰でも無料で利用することができます。

ログインをするとチャット画面が表示され、ここに質問や指示を入力すると、あたかも人間がチャットに応じているように自然な回答を返します。このようなチャットツールは英語のみに対応するものが多い中で、ChatGPTは英語のみ日本語などにも対応しており、その回答は非常に流暢です。

ChatGPTでできることは数多く存在しますが、たとえば次のことなどを行うことができます。

ブログ記事の構成作成

ブログ記事の執筆

簡単な小説やプロットの執筆

メール文章の執筆

表の作成

翻訳

プログラムの生成

文章の要約

文章やプログラムコードの添削

議事録の作成

論点の洗い出しやアイディアの提案

ChatGPTに適切な指示を与えることができれば、非常に高い制度のアウトプットが得られます。そのため、ChatGPTを適切に使用すれば、業務効率化に大きく寄与することとなるでしょう。

ChatGPTを業務で利用する際の注意点

冒頭で紹介した事件を一笑に付すのは簡単かもしれません。しかし、ChatGPTの利用がこれほどまでに広がっている今、自社の従業員がこれと似た重大なミスをする可能性を100%否定することができるでしょうか?

この事件を受け、ChatGPTを業務利用する際には改めて次の点に注意を払うことをおすすめします。また、これらの注意点は、自社の従業員や業務委託先などとも十分に共有する必要があるでしょう。

ChatGPTのアウトプットを信頼しすぎない

ChatGPTのアウトプットは、必ずしも正確であるとは限りません。さらに根深い問題は、架空の内容をあたかも事実であるかのようにアウトプットすることがある点です。

説得力のある文章の中に真偽不明な情報が組み込まれることもあり、注意を払っていなければ情報をそのまま信じてしまう可能性があります。

そのため、業務にChatGPTを活用する際には、そのアウトプットについて、情報の真偽を人の目で十分に確認しなければなりません。特に、紹介した事例のように裁判所に提出する書面や医療に関する情報など、人の身体や財産に重大な影響を及ぼしかねない内容であればなおさらです。

上で紹介した事例において、弁護士が裁判の準備書面の原案をChatGPTで作成したこと自体は特に問題ないでしょう(ただし、次で解説をするセキュリティ面の懸念はあります)。これ自体は、業務の効率化につながる革新的な取り組みです。

問題は、この弁護士がChatGPTのアウトプットした内容を十分に確認しないまま裁判所に提出した点にあります。

特に今回問題となっている判例の情報などは、その判例が実在するものかどうか、またその内容が正しいものであるかどうか、信頼できる原拠をあたるべきでした。

なお、当然ながらそのアウトプットの正確性の確認は、ChatGPTで行ってはなりません。ChatGPTが「誤解」している内容の真偽をChatGPTに問うてみたところで、真偽が正確に判断できるはずはないためです。

機密情報が漏洩するリスクがある

今回の事例では特に問題とされているところではないものの、ChatGPTを業務に活用する際には、情報漏洩のリスクにも注意しなければなりません。なぜなら、ChatGPTに入力した情報はChatGPTの学習用データとして取り込まれる可能性があるほか、ChatGPTを開発しているOpenAI社の開発者の目に触れる可能性があるためです。

これは、ChatGPTの公式ヘルプページでも明記されていることであり、決して推測からの懸念事項ではありません。そのため、実際にChatGPTの業務使用を禁じたり、ChatGPTへの機密情報の入力を禁じたりする企業も登場しています。

ChatGPTを業務に使用する際には自社の業務の特性も踏まえ、情報漏洩のリスクも視野に入れて使用が適切であるかどうかを必要があるでしょう。

なお、2023年4月の仕様変更により、ChatGPTに入力したデータを学習用データとして活用させない「オプトアウト設定」が簡単に行えるようになりました。オプトアウト申請は、ログイン後の画面左下の設定画面から、簡単に行うことが可能です。

ChatGPTに学習されたくない情報を入力する際には、忘れずにこのオプトアウト設定をしておきましょう。

まとめ

ChatGPTは非常に便利なツールである一方で、一つ使い方を誤れば、紹介をした事例のように大きなトラブルへと発展してしまいかねません。

ChatGPTはあくまでも「参考ツール」や「業務効率化ツール」であり、万能AIではないことを理解しておく必要があるでしょう。

ここで紹介した事例は、決して他人事ではありません。この事例を、自社におけるChatGPTの利用方法を見直したり、従業員を啓蒙したりするきっかけとすることをおすすめします。

たきざわ法律事務所はインターネット法務を得意としており、インターネットにまつわるトラブル解決やトラブル予防に力を入れています。ChatGPTの使用にまつわる社内規程を整備したい場合やChatGPT使用のルールを業務委託先との契約書に盛り込みたい場合、その他ChatGPTにまつわるトラブルでお困りの際などには、たきざわ法律事務所までお気軽にお問い合わせください。